29. Oktober 2025, 17:28 Uhr | Lesezeit: 5 Minuten

Seit Jahrzehnten geht der Trend bei Fernsehern zu immer höheren Auflösungen. Mittlerweile ist 4K De-facto-Standard und die Hersteller versuchen, den Verbrauchern sogar 8K aufzudrücken. Dabei ist bereits länger bekannt, dass höhere Auflösungen nur in sehr bestimmten Fällen einen Vorteil bieten. Das belegt nun auch eine neue Studie aus Cambridge.

Unsere Augen sind zwar durchaus in der Lage, sehr hohe Auflösungen wahrzunehmen. Aber nicht auf die Art und Weise, wie TV-Hersteller Nutzern vorgaukeln wollen. Forscher der University of Cambridge und von Meta haben herausgefunden, dass die sogenannte „retinale Auflösung“ über den bisher geltenden Standards liegt. Damit ist die maximale Bildschärfe gemeint, die das menschliche Auge wahrnehmen kann. So weit die Theorie. Doch in der Praxis kann es nur in bestimmten Szenarien davon Gebrauch machen – und Fernsehen fällt der Studie zufolge nicht darunter.

Der Retina-Mythos

2010 hat Apple das Retina-Display mit dem iPhone 4 eingeführt – ein Marketing-Begriff, der die Pixeldichte beschreiben soll, bei der das Auge keine einzelnen Bildpunkte mehr ausmachen kann. Steve Jobs zufolge müsse die Pixeldichte bei voller 20/20-Sehkraft 58 PPD umfassen. Dabei handelt es sich um die Anzahl der Pixel pro Grad Sichtfeld. In der Industrie hat sich das als Quasi-Standard festgesetzt.

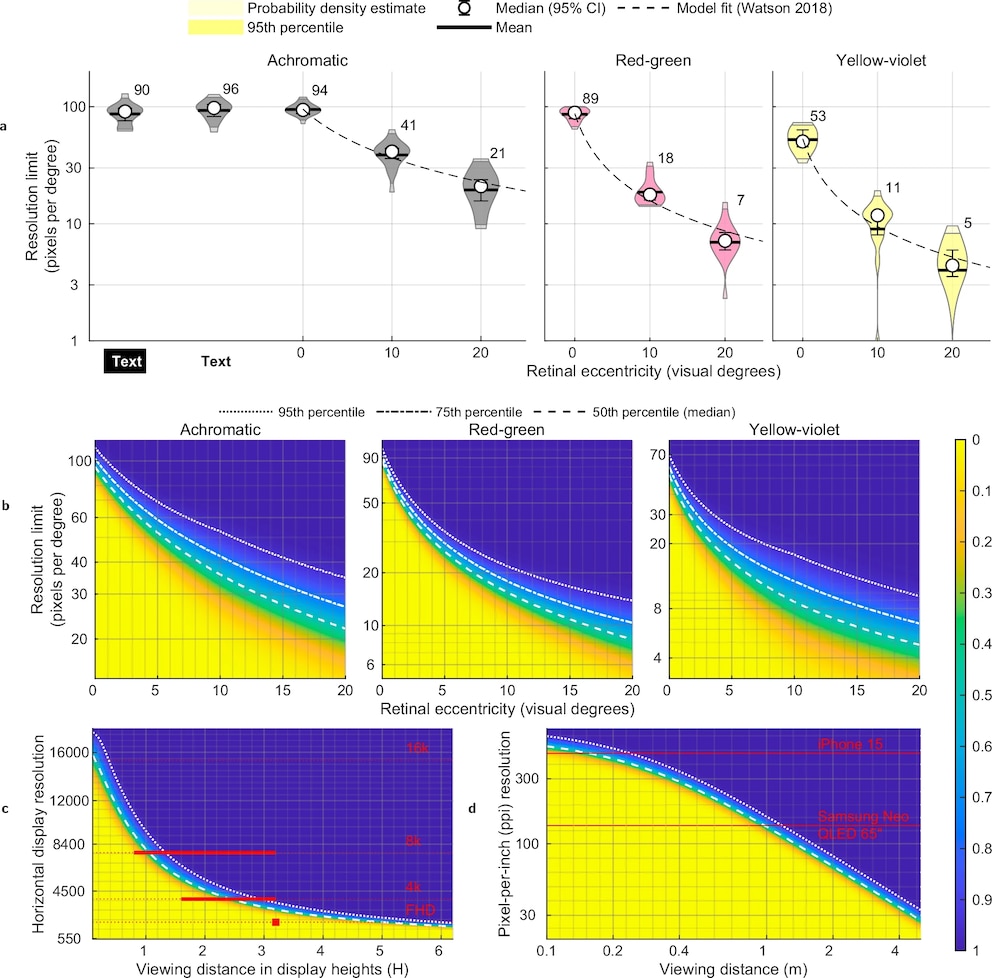

Die neue Studie von Maliha Ashraf, Alexandre Chapiro und Rafał K. Mantiuk kommt jedoch zu einem anderen Ergebnis. Die Teilnehmer konnten im Schnitt bis zu 94 PPD wahrnehmen – und einzelne sogar bis zu 120 PPD. Damit liegt die tatsächliche Sehschärfe des Menschen rund 50 Prozent über dem bisherigen Standard.

Den Forschern zufolge nehmen unsere Augen Farben jedoch unterschiedlich scharf wahr. Bei Schwarz-Weiß-Kontrasten erkennen sie 89 PPD und bei Rot-Grün-Kontrasten sogar 94 PPD. Anders sieht es bei Gelb-Violett-Mustern aus, bei denen die Wahrnehmung auf 53 PPD sinkt. Das deckt sich mit der sehwissenschaftlichen Theorie, dass das Auge auf dem Rot-Grün-Kanal am sensibelsten reagiert.

So findet man die ideale Fernseher-Größe fürs Zuhause

So berechnet man den richtigen Sitzabstand zum Fernseher

8K? Nur aus der Nähe sinnvoll

Für die Studie haben die Forscher einen Monitor auf einer motorisierten Halterung angebracht, die den Abstand zum Beobachter millimetergenau verändern kann. Den Studienteilnehmern wurden bei jedem Abstand zwei Arten von Bildern in zufälliger Reihenfolge gezeigt: Vertikale Linien (ein Pixel breit) in Schwarz/Weiß, Rot/Grün oder Gelb/Violett, oder ein einfacher grauer Block. Die Teilnehmer mussten dann angeben, welches Bild die Linien enthielt.

Auf diese Art konnten die Forscher das „Auflösungslimit“ finden: Der Punkt, an dem die Auflösung zu hoch oder die Linien zu dünn sind, als dass sie mit bloßem Auge erkennbar sind. In der Studie reizten selbst 4K-Displays die menschliche Wahrnehmung in der Regel bereits bei einem Sitzabstand von 3 Displayhöhen aus. Die International Telecommunication Union (ITU) empfiehlt für 8K-Displays einen Sitzabstand von 0,8 bis 3,2 Displayhöhen. Die Studie hingegen kommt zu dem Ergebnis, dass das Auge Pixel erst dann ausmachen kann, wenn man näher als 1,3 Displayhöhen entfernt sitzt.

Lesen Sie auch: Für wen lohnt sich ein 4K-Monitor?

Anders gesagt: Wer einen 8K-Fernseher mit 65 Zoll Diagonale besitzt, müsste weniger als einen Meter davor sitzen, um den Unterschied zu 4K überhaupt wahrzunehmen. Bei normalem Sitzabstand ist das Auge längst am Auflösungslimit. Für Verbraucher haben die Forscher einen Online-Rechner entwickelt, der genau zeigt, welcher Sitzabstand bei welcher Auflösung und Displaygröße optimal ist.

Die Cambridge-Studie stellt damit klar, dass unsere Augen ihre Grenzen haben – aber nicht dort, wo Marketingabteilungen sie ziehen. 4K ist für fast alle Alltagssituationen mehr als ausreichend. 8K lohnt sich höchstens bei extrem kurzen Sitzabständen oder bei spezifischen Anwendungen wie professioneller Bildbearbeitung, Simulationen oder VR.

Wichtige Erkenntnis für Mixed Reality und Streaming

Für die Forschung und Industrie sind die Ergebnisse ein echter Meilenstein. Sie liefern neue Referenzwerte für die Entwicklung von Displays, Rendering-Technologien und Videocodecs.

Gerade für Virtual- und Augmented-Reality-Headsets sind die Erkenntnisse entscheidend: Durch sogenannte „foveated rendering“-Techniken wird nur der Bereich scharf dargestellt, auf den das Auge fokussiert. Die neuen Daten ermöglichen es, diese Verfahren genauer auf das menschliche Sehen abzustimmen – und so Rechenleistung und Bandbreite zu sparen.

Auch für die Videokomprimierung bei Streaming sind die Ergebnisse relevant. Die Erkenntnis, dass unsere Augen am besten Rot und Grün unterscheiden können, bietet Raum für Verbesserung. Dieser Kontrast könnte zukünftig besser abgebildet werden, während andere Muster, die wir weniger gut unterscheiden können, weiter komprimiert werden.

Das Gesetz des abnehmenden Grenzertrags

„Dass Hersteller mit dem Versuch, höhere Auflösungen als die Zukunft für TV-Geräte zu definieren, in eine Sackgasse laufen, dürfte vielen bereits klar gewesen sein. Die gemeinsame Studie der Cambridge- und Meta-Forscher zeigt jedoch jetzt eindeutig, dass 4K für Verbraucher absolut ausreichend ist.

Es gibt meiner Meinung nach viele andere Punkte, in denen Displays besser werden können. Dabei denke ich vor allem an die Helligkeit. Es gibt immer mehr Hersteller, die an der Nits-Schraube drehen. Auf der diesjährigen CES hat Hisense etwa den ersten Fernseher mit wahnsinnigen 10.000 Nits vorgestellt – das ist Fortschritt, das schafft ein realitätsnahes TV-Erlebnis. Denn unsere Welt ist bunt und hell. Wenn mich die Sonne aus dem Fernseher mit einer vertrauten Wärme anstrahlt, ist mir völlig egal, in welcher Auflösung ich sie sehe.“